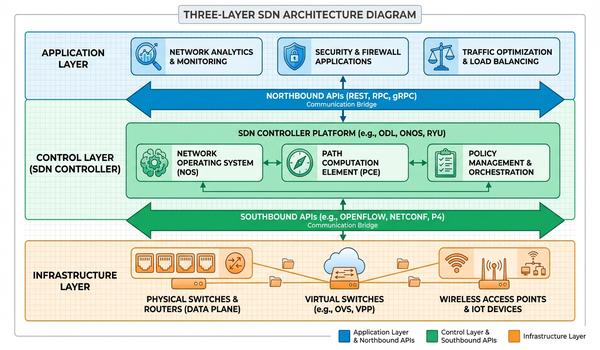

Tradycyjna architektura sieciowa opiera się na urządzeniach, w których warstwa sterowania i warstwa

danych są ze sobą nierozerwalnie połączone. Sieci definiowane programowo (SDN, ang. Software-Defined

Networking) wprowadzają rewolucyjną zmianę poprzez oddzielenie warstwy sterowania od fizycznego sprzętu

przesyłającego pakiety. Centralizacja sterowania pozwala administratorom na programowe zarządzanie całą

infrastrukturą z poziomu jednego kontrolera. Dzięki temu sieć staje się bardziej elastyczna i zdolna do

dynamicznego reagowania na zmieniające się potrzeby aplikacji. SDN umożliwia automatyzację procesów,

które wcześniej wymagały ręcznej konfiguracji każdego przełącznika i routera z osobna. Takie podejście

znacząco redukuje ryzyko błędów ludzkich oraz przyspiesza wdrażanie nowych usług w centrach danych.

Współczesne systemy SDN są fundamentem wysoce skalowalnych środowisk chmurowych.